Tugevdamise õppimise bioloogiat võib leida aadressil Operantne konditsioneerimine ja premeerimine.

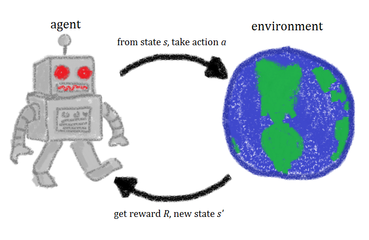

Võimendusõpe (RL) on tarkvaraagendi õpetamine, kuidas keskkonnas käituda, öeldes talle, kuidas ta hästi käitub. See on masinõppe valdkond, mis on inspireeritud käitumispsühholoogiast. Võimendusõppes ei õpetata agenti otseselt tegema kindlat käsku, vaid määratletakse eesmärk (preemia) ja agent õpib ise sellise käitumisstrateegia, mis maksimeerib kogutud preemiat.

Võimendusõpe erineb juhitavast õppest, sest õiged sisendid ja väljundid ei ole kunagi näidatud. Samuti õpib tugevdav õppimine tavaliselt jooksvalt (veebipõhine õppimine), erinevalt juhitavast õppimisest. See tähendab, et agent peab valima, kas uurida (explore) uusi tegevusi või kasutada juba teadaolevat häid lahendusi (exploit) — seda nimetatakse uurimise ja kasutamise kompromissiks.

Põhimõtted ja põhikomponendid

- Agent — otsustav üksus, kes sooritab tegevusi.

- Keskkond — maailm, millega agent suhtleb ja mis tagastab tagasisidet.

- Seisund (state) — keskkonna kirjeldus hetkel, mil agent teeb otsuse.

- Tegevus (action) — valikud, mida agent saab teha.

- Preemia (reward) — kohene tagasiside, mis mõõdab tegevuse soodsust eesmärgi saavutamiseks.

- Poliitika (policy) — reegel või funktsioon, mis määrab, millist tegevust mingis seisundis valida.

- Väärtusfunktsioon (value) — hinnang selle kohta, kui hea on mingi seisund või seisund-tegevus paar pikas perspektiivis.

- Märkov otsustusprotsess (MDP) — formaalne raamistik, mida RL sageli kasutab, kui järgmine seisund ja preemia sõltuvad ainult praegusest seisundist ja valitud tegevusest.

Peamised tüübid ja algoritmid

RL-algoritme saab üldiselt jagada kaheks: mudelipõhised (model-based), kus agent õpib keskkonna dünaamikaid ja planeerib, ning mudelivabad (model-free), kus agent õpib otseselt väärtusi või poliitikat ilma eksplitsiitse mudelita.

- Q-learning — populaarne mudelivaba algoritm, mis õpib väärtusfunktsiooni (Q-funktsiooni) ja võimaldab valida tegevuse, mis maksimeerib hinnangulist preemiat.

- SARSA — sarnane Q-learningule, kuid õpib väärtusi vastavalt tegelikule järgnevatele tegevustele agenti käitumise all.

- Aktiivsed meetodid ja poliitika otsene õppimine — nt poliitika gradientid, kus poliitika optimeeritakse otse.

- Sügavad võrgud kombinatsioonis RL-iga — nt DQN (Deep Q-Network), mis kasutavad sügavaid närvivõrke suurte seisundiruumi puhul.

- Tänapäevased täiustused — proximal policy optimization (PPO), actor-critic meetodid (A2C, A3C, DDPG, SAC) jpm, mis pakuvad stabiilsemat ja efektiivsemat õppimist keerukates ülesannetes.

Rakendused

- Robootika — autonoomsed liikumis- ja manipuleerimisülesanded.

- Mängud — nii strateegia- kui ka lauamängud (näiteks male, Go) ning videomängud, kus RL on näidanud inimtasemel sooritust.

- Soovitussüsteemid ja reklaam — otsuste tegemine, millist sisu näidata, et maksimeerida kasutaja kaasatust.

- Autonoomsed sõidukid — juhtimisstrateegiate õppimine keerukates olukordades.

- Finants- ja portfellihaldus — strateegiate õppimine turuolukorra põhjal.

- Tööstusprotsesside optimeerimine ja ressursihaldus.

Väljakutsed ja piirangud

- Proovivõtute efektiivsus — palju RL-algoritme nõuavad suurt hulka proovikordi ja seetõttu suurt arvutus- ning andmemahtu.

- Uurimise ja kasutamise kompromiss — kuidas turvaliselt ja efektiivselt uurida uusi strateegiaid ilma suuri kahjusid tekitamata.

- Tasude disainimise raskus — vale või halvasti määratletud preemia võib viia soovimatute käitumiseni.

- Ülekantavus — simuleeritud keskkonnas õpitu ei pruugi otse reaalses maailmas toimida (sim2real probleem).

- Ohutus ja eetika — RL-lahendused võivad otsida lühimatselist kasu viisil, mis ei sobi reaalse maailma piirangutega.

Kokkuvõte

Võimendusõpe on paindlik ja võimas lähenemine, mis võimaldab agendil õppida järjestikuste otsuste tegemist eesmärgiga maksimeerida pikaajalist kasu. Tänu sügavate närvivõrkude ja edasijõudnud optimeerimismeetodite arengule on RL jõudnud paljudesse praktilistesse rakendustesse, kuid püsivad väljakutsed (näiteks efektiivsus, ohutus ja tasude disain) on aktiivse uurimistöö teema.